Konferencja LUSTRO MEDIÓW IV: OD CHAT BOTÓW DO CX I UX jest wspólnym przedsięwzięciem organizacyjnym badaczy Politechniki Gdańskiej, Uniwersytetu Gdańskiego i Uniwersytetu Jagiellońskiego oraz Pomorskiego Instytutu Naukowego im. Profesora Brunona Synaka

Gdy pod koniec 2022 roku pojawiły się artykuły naukowe, w których sztuczna inteligencja została umieszczona w roli współautora, dyskusja nad tymi przypadkami dołączyła do chóru głosów na temat sensacji kulturowej: przełomowej / destrukcyjnej innowacji (z perspektywy zarządzania), „niekończącej” się rozrywki (z potencjałem uzależniania), dobrodziejstwa kreacji literatury, ale i zagrożeń. Reprezentatywną dla środowiska naukowego była deklaracja magazynu „Science”, który zaktualizował swoje zasady licencyjne i redakcyjne, oświadczając „ChatGPT to zabawa, ale nie autor”. Podobnie postąpiły Elsevier (2800 czasopism) oraz Springer (3000 czasopism) i inne. Ale czy istotnie chatboty to tylko zabawa?

W teorii mediów idea uzupełnienia i substytucji człowieka przez sztuczną inteligencję jest dopełnieniem koncepcji „przedłużenia człowieka” McLuhana; media poszerzały i wspierały różne ludzkie zdolności w toku ewolucji człowieka i rozwoju cywilizacji. W ramach takiej interpretacji pojawienie się sztucznej inteligencji można rozważać jako nieunikniony wynik ewolucji mediów.

Ale nie tylko: sztuczna inteligencja występuje w roli uzupełnienia i substytutu człowieka w pracy. Do 2025 roku swe dotychczasowe zajęcie ma za jej sprawą utracić 95 milionów pracowników, choć jednocześnie ma powstać nieco więcej nowych miejsc pracy (ale już innych). „Zagrożone” mają być przede wszystkim zawody najlepiej płatne - pracowników mediów, programistów, a zwłaszcza human resources (np. Eloundou i in. 2023).

W praktyce istnieją branże, które są zainteresowane głównie zdolnościami obliczeniowymi sztucznej inteligencji, takie jak media społecznościowe, czy wirtualni asystenci. Jest to „wąska” sztuczna inteligencja - asystent niedoskonałych ludzi. Istnieją jednak także branże, które starają się nie tylko rozwijać lepszą, ogólną sztuczną inteligencję (jak zapowiadany na koniec 2023 roku ChatGPT 5 czy Gemini Google), ale zastąpić ludzi. Należą do nich na przykład media i wojsko. Postęp w tej materii jest dobrze znany: sztuczna inteligencja coraz częściej na podstawie analiz big data i korelacji identyfikuje zainteresowania użytkowników i współdecyduje w redakcjach o tym, co jest warte opublikowania oraz pozwala dziennikarzom i marketerom lepiej poznać „wyobrażonego” odbiorcę. Algorytmy mają lepiej od człowieka „zrozumieć” preferencje użytkowników i klientów, a po spodziewanym dołączeniu danych biometrycznych osiągnąć „precyzję wariografu” społeczeństwa; stać się wariografem globalnej wioski (Miroshnichenko 2018).

Czynnik sprawczy tych starań też jest „tradycyjny”: to poszukiwanie większej efektywności kosztowej i maksymalizacja zysku oraz… dążenie do jeszcze większego społecznego dobrostanu. Dziś maszyny moderują dyskusje w mediach społecznościowych, coraz też częściej człowiek nie potrafi odróżnić tekstów, obrazu i video (w tym promocyjnych) tworzonych przez bio-twórcę od tworzonych przez maszyny (np. Tewari i in., 2021).

Sztuczna inteligencja przewyższa już dziennikarzy we wszystkich elementach dotyczących przetwarzania danych i może konkurować z ludźmi w tej części ich aktywności, która wiąże się z unikatowym stylem; ponieważ ChatGPT może naśladować charakterystyczny styl twórcy (Elkins i Chun, 2020), Radford i in. (2019) nadali mu miano technologii „kameleonowej”. Współczesne maszyny sprawiają, że tworzone przez nie wiadomości wydają się też bardziej osobiste, tak pod względem tonu, jak i treści. Ponieważ dla większości ludzi sztuczna inteligencja wydaje się „czarną skrzynką”, towarzyszą jej różne tzw. teorie ludowe, czyli nieprecyzyjne, intuicyjne, które mają szerokie implikacje: organizują doświadczenie, skłaniają do wnioskowania, kierują uczeniem się oraz wpływają na zachowanie i interakcje społeczne (Gelman, Legare 2011).

Sztuczna inteligencja nie powstała ponadto z myślą o potrzebach mediów (czy innego konkretnego sektora), w trosce o wpływie kulturowym lub odpowiedzialności demokratycznej (Diakopoulos 2019 ). Może to oznaczać, że dziennikarstwo i marketing (ale i nauka) nie kieruje się już własnymi zasadami i normami w dążeniu do prawdy i przy ocenie informacji, ale muszą brać pod uwagę relacje z zewnętrznymi podmiotami, takimi jak firmy big tech, czy startupy nowych technologii. Ma to wpływ dla konceptualizacji ich niezależności. W mediach dotyczy to pełnienia przez dziennikarzy roli „czwartej władzy” w demokracjach (Helberger i in. 2019 ) i skłania do rewidowania dziennikarskiej roli normatywnej i kognitywnej, ideologii oraz tożsamości dziennikarzy i twórców.

Tymczasem tak ekspansywna sztuczna inteligencja jest, co oczywiste ze względu na jej etap rozwoju, daleka od doskonałości. Oparte na niej chatboty replikują ludzkie uprzedzenia i mają „halucynacje”, czyli zmyślają odpowiedzi (np. Stokel-Walker, 2022), jednocześnie jednak mają się sprawdzać przy analizowaniu dokładności prezentowanych informacji (Shahriar, Hayawi, 2023) oraz identyfikacji tzw. mowy nienawiści (Huanga i in.,2023), choć nadal wymagają ludzkiego nadzoru (Redley, 2022). Wykorzystanie maszyn indeksujących do tworzenia korpusów dla LLM narusza prawa autorskie (Brown i in., 2021).

Jednocześnie z jednej strony zarzuca się popularnym chatbotom brak kreatywności (Burrell J. 2023), ale z drugiej strony zdolność sztucznej inteligencji identyfikowania korelacji ma niwelować tę ułomność. Chatboty nie „rozumieją” piękna ani oryginalności, ale mogą odczytywać i mierzyć reakcje na piękno oraz oryginalną twórczość i są przydatne choćby w przygotowaniu do wywiadów formułując pytania (Cemaj Hochstein 2023).

Reasumując, gdy dotychczas narzędzia i mechanizmy były „przedłużeniem ludzi”, ludzie mogą teraz być dobrymi „rozszerzeniami” dla maszyn umożliwiając im rozwijanie ich zdolności i przekraczanie ich „naturalnych” ograniczeń. Czy zatem nadszedł zapowiadany przez Marshalla McLuhana (1969) czas rewizji poglądu, kto komu służy? Starając się odpowiedzieć na te i inne pytania, zapraszamy Państwa na kolejną czwartą konferencję z cyklu „Lustro Mediów”. Poprzednie dotyczyły Facebooka, Google i mowy nienawiści, najnowsza jest poświęcona sztucznej inteligencji w jej (nie tylko) medialnych i marketingowych odsłonach.

I tym razem konferencja jest wspólnym przedsięwzięciem organizacyjnym badaczy Wydziału Zarządzania i Ekonomii Politechniki Gdańskiej, Wydziału Zarządzania Uniwersytetu Gdańskiego, Wydziału Dziennikarstwa, Mediów i Komunikacji Społecznej Uniwersytetu Jagiellońskiego oraz Pomorskiego Instytutu Naukowego im. Profesora Brunona Synaka.

W teorii mediów idea uzupełnienia i substytucji człowieka przez sztuczną inteligencję jest dopełnieniem koncepcji „przedłużenia człowieka” McLuhana; media poszerzały i wspierały różne ludzkie zdolności w toku ewolucji człowieka i rozwoju cywilizacji. W ramach takiej interpretacji pojawienie się sztucznej inteligencji można rozważać jako nieunikniony wynik ewolucji mediów.

Ale nie tylko: sztuczna inteligencja występuje w roli uzupełnienia i substytutu człowieka w pracy. Do 2025 roku swe dotychczasowe zajęcie ma za jej sprawą utracić 95 milionów pracowników, choć jednocześnie ma powstać nieco więcej nowych miejsc pracy (ale już innych). „Zagrożone” mają być przede wszystkim zawody najlepiej płatne - pracowników mediów, programistów, a zwłaszcza human resources (np. Eloundou i in. 2023).

W praktyce istnieją branże, które są zainteresowane głównie zdolnościami obliczeniowymi sztucznej inteligencji, takie jak media społecznościowe, czy wirtualni asystenci. Jest to „wąska” sztuczna inteligencja - asystent niedoskonałych ludzi. Istnieją jednak także branże, które starają się nie tylko rozwijać lepszą, ogólną sztuczną inteligencję (jak zapowiadany na koniec 2023 roku ChatGPT 5 czy Gemini Google), ale zastąpić ludzi. Należą do nich na przykład media i wojsko. Postęp w tej materii jest dobrze znany: sztuczna inteligencja coraz częściej na podstawie analiz big data i korelacji identyfikuje zainteresowania użytkowników i współdecyduje w redakcjach o tym, co jest warte opublikowania oraz pozwala dziennikarzom i marketerom lepiej poznać „wyobrażonego” odbiorcę. Algorytmy mają lepiej od człowieka „zrozumieć” preferencje użytkowników i klientów, a po spodziewanym dołączeniu danych biometrycznych osiągnąć „precyzję wariografu” społeczeństwa; stać się wariografem globalnej wioski (Miroshnichenko 2018).

Czynnik sprawczy tych starań też jest „tradycyjny”: to poszukiwanie większej efektywności kosztowej i maksymalizacja zysku oraz… dążenie do jeszcze większego społecznego dobrostanu. Dziś maszyny moderują dyskusje w mediach społecznościowych, coraz też częściej człowiek nie potrafi odróżnić tekstów, obrazu i video (w tym promocyjnych) tworzonych przez bio-twórcę od tworzonych przez maszyny (np. Tewari i in., 2021).

Sztuczna inteligencja przewyższa już dziennikarzy we wszystkich elementach dotyczących przetwarzania danych i może konkurować z ludźmi w tej części ich aktywności, która wiąże się z unikatowym stylem; ponieważ ChatGPT może naśladować charakterystyczny styl twórcy (Elkins i Chun, 2020), Radford i in. (2019) nadali mu miano technologii „kameleonowej”. Współczesne maszyny sprawiają, że tworzone przez nie wiadomości wydają się też bardziej osobiste, tak pod względem tonu, jak i treści. Ponieważ dla większości ludzi sztuczna inteligencja wydaje się „czarną skrzynką”, towarzyszą jej różne tzw. teorie ludowe, czyli nieprecyzyjne, intuicyjne, które mają szerokie implikacje: organizują doświadczenie, skłaniają do wnioskowania, kierują uczeniem się oraz wpływają na zachowanie i interakcje społeczne (Gelman, Legare 2011).

Sztuczna inteligencja nie powstała ponadto z myślą o potrzebach mediów (czy innego konkretnego sektora), w trosce o wpływie kulturowym lub odpowiedzialności demokratycznej (Diakopoulos 2019 ). Może to oznaczać, że dziennikarstwo i marketing (ale i nauka) nie kieruje się już własnymi zasadami i normami w dążeniu do prawdy i przy ocenie informacji, ale muszą brać pod uwagę relacje z zewnętrznymi podmiotami, takimi jak firmy big tech, czy startupy nowych technologii. Ma to wpływ dla konceptualizacji ich niezależności. W mediach dotyczy to pełnienia przez dziennikarzy roli „czwartej władzy” w demokracjach (Helberger i in. 2019 ) i skłania do rewidowania dziennikarskiej roli normatywnej i kognitywnej, ideologii oraz tożsamości dziennikarzy i twórców.

Tymczasem tak ekspansywna sztuczna inteligencja jest, co oczywiste ze względu na jej etap rozwoju, daleka od doskonałości. Oparte na niej chatboty replikują ludzkie uprzedzenia i mają „halucynacje”, czyli zmyślają odpowiedzi (np. Stokel-Walker, 2022), jednocześnie jednak mają się sprawdzać przy analizowaniu dokładności prezentowanych informacji (Shahriar, Hayawi, 2023) oraz identyfikacji tzw. mowy nienawiści (Huanga i in.,2023), choć nadal wymagają ludzkiego nadzoru (Redley, 2022). Wykorzystanie maszyn indeksujących do tworzenia korpusów dla LLM narusza prawa autorskie (Brown i in., 2021).

Jednocześnie z jednej strony zarzuca się popularnym chatbotom brak kreatywności (Burrell J. 2023), ale z drugiej strony zdolność sztucznej inteligencji identyfikowania korelacji ma niwelować tę ułomność. Chatboty nie „rozumieją” piękna ani oryginalności, ale mogą odczytywać i mierzyć reakcje na piękno oraz oryginalną twórczość i są przydatne choćby w przygotowaniu do wywiadów formułując pytania (Cemaj Hochstein 2023).

Reasumując, gdy dotychczas narzędzia i mechanizmy były „przedłużeniem ludzi”, ludzie mogą teraz być dobrymi „rozszerzeniami” dla maszyn umożliwiając im rozwijanie ich zdolności i przekraczanie ich „naturalnych” ograniczeń. Czy zatem nadszedł zapowiadany przez Marshalla McLuhana (1969) czas rewizji poglądu, kto komu służy? Starając się odpowiedzieć na te i inne pytania, zapraszamy Państwa na kolejną czwartą konferencję z cyklu „Lustro Mediów”. Poprzednie dotyczyły Facebooka, Google i mowy nienawiści, najnowsza jest poświęcona sztucznej inteligencji w jej (nie tylko) medialnych i marketingowych odsłonach.

I tym razem konferencja jest wspólnym przedsięwzięciem organizacyjnym badaczy Wydziału Zarządzania i Ekonomii Politechniki Gdańskiej, Wydziału Zarządzania Uniwersytetu Gdańskiego, Wydziału Dziennikarstwa, Mediów i Komunikacji Społecznej Uniwersytetu Jagiellońskiego oraz Pomorskiego Instytutu Naukowego im. Profesora Brunona Synaka.

PRZEWODNICZĄCY RADY NAUKOWEJ KONFERENCJI

Prof. dr hab. Jan Kreft | Politechnika Gdańska, WZiE

CZŁONKOWIE RADY NAUKOWEJ KONFERENCJI

Prof. dr hab. Janusz Adamowski I Uniwersytet Warszawski

Prof. dr hab. Iwona Hofman I Uniwersytet Marii Curie Skłodowskiej

Prof. dr. hab. Jan Hudzik | Uniwersytet Marii Curie Skłodowskiej

Prof. dr hab. Stanisław Jędrzejewski | Akademia Leona Koźmińskiego

Prof. dr hab. Klaus Bachman | Uniwersytet SWPS

Prof. Aelita Skaržauskienė | Vilnius Gediminas Technical University (Lithuania), Social Technologies LAB Mykolas Romeris Universitey (Vilnus)

Prof. dr hab. Tadeusz Kononiuk I Uniwersytet Warszawski

Prof. dr hab. Mirosław Szreder | WZR Uniwersytet Gdański

Dr hab. Marzena Barańska, prof. UJ | Wydział Zarządzania i Komunikacji Społecznej, Uniwersytet Jagielloński

Dr hab. Robert Bęben, prof. UG | Uniwersytet Gdański

Dr hab. Monika Boguszewicz – Kreft, prof. Uniwersytetu WSB Merito Gdańsk

Dr hab. Piotr Celiński, prof. UMCS | Uniwersytet Marii Curie Skłodowskiej

Dr hab. inż. Dariusz Dąbrowski | WZiE Politechnika Gdańska

Dr hab. Łukasz Gaweł, prof. UJ, Uniwersytet Jagielloński | Dyrektor Muzeum Narodowego w Warszawie

Dr hab. Małgorzata Gawrycka, prof. PG | WZiE Politechnika Gdańska

Dr hab. Edyta Gołąb-Andrzejak, prof. PG I Politechnika Gdańska

Dr hab. Agnieszka Hess, Prof. UJ I Uniwersytet Jagielloński

Dr hab. Lucyna Szot, Prof. UWr I Uniwersytet Wrocławski

Dr hab. Monika Kaczmarek-Śliwińska I Uniwersytet Warszawski

Dr hab. Anna Kalinowska-Żeleźnik, prof. WSB Merito | Uniwersytet WSB Merito

Dr hab. Andrzej Lisak | WZiE Politechnika Gdańska

Dr hab. Krzysztof Leja, prof. PG | WZiE Politechnika Gdańska

Dr hab. Rafał Maciąg, prof. UJ | Uniwersytet Jagielloński

Dr hab. Weronika Świerczyńska-Głownia, prof. UJ I Uniwersytet Jagielloński

Dr Sylwia Kuczamer - Kłopotowska, Wydział Zarządzania, Uniwersytet Gdański | Pomorski Instytut Naukowy im. Profesora Brunona Synaka

KOMITET ORGANIZACYJNY

Dr Sylwia Kuczamer - Kłopotowska I Wydział Zarządzania, Uniwersytet Gdański | Pomorski Instytut Naukowy im. Profesora Brunona Synaka

Dr Marta Szeluga-Romańska | Wydział Zarządzania i Ekonomii, Politechnika Gdańska

Mgr Monika Hapek I Wydział Zarządzania i Komunikacji Społecznej, Uniwersytet Jagielloński

Mgr Anna Młynkowiak-Stawarz I Wydział Zarządzania, Uniwersytet Gdański | Pomorski Instytut Naukowy im. Profesora Brunona Synaka

Mgr Zuzanna Minga I Wydział Zarządzania, Uniwersytet Gdański

Olga Gałęska I Wydział Zarządzania, Uniwersytet Gdański

Mgr Barbara Cyrek I Wydział Zarządzania i Komunikacji Społecznej, Uniwersytet Jagielloński

Aleksandra Boike | Pomorski Instytut Naukowy im. Profesora Brunona Synaka

Prof. dr hab. Jan Kreft | Politechnika Gdańska, WZiE

CZŁONKOWIE RADY NAUKOWEJ KONFERENCJI

Prof. dr hab. Janusz Adamowski I Uniwersytet Warszawski

Prof. dr hab. Iwona Hofman I Uniwersytet Marii Curie Skłodowskiej

Prof. dr. hab. Jan Hudzik | Uniwersytet Marii Curie Skłodowskiej

Prof. dr hab. Stanisław Jędrzejewski | Akademia Leona Koźmińskiego

Prof. dr hab. Klaus Bachman | Uniwersytet SWPS

Prof. Aelita Skaržauskienė | Vilnius Gediminas Technical University (Lithuania), Social Technologies LAB Mykolas Romeris Universitey (Vilnus)

Prof. dr hab. Tadeusz Kononiuk I Uniwersytet Warszawski

Prof. dr hab. Mirosław Szreder | WZR Uniwersytet Gdański

Dr hab. Marzena Barańska, prof. UJ | Wydział Zarządzania i Komunikacji Społecznej, Uniwersytet Jagielloński

Dr hab. Robert Bęben, prof. UG | Uniwersytet Gdański

Dr hab. Monika Boguszewicz – Kreft, prof. Uniwersytetu WSB Merito Gdańsk

Dr hab. Piotr Celiński, prof. UMCS | Uniwersytet Marii Curie Skłodowskiej

Dr hab. inż. Dariusz Dąbrowski | WZiE Politechnika Gdańska

Dr hab. Łukasz Gaweł, prof. UJ, Uniwersytet Jagielloński | Dyrektor Muzeum Narodowego w Warszawie

Dr hab. Małgorzata Gawrycka, prof. PG | WZiE Politechnika Gdańska

Dr hab. Edyta Gołąb-Andrzejak, prof. PG I Politechnika Gdańska

Dr hab. Agnieszka Hess, Prof. UJ I Uniwersytet Jagielloński

Dr hab. Lucyna Szot, Prof. UWr I Uniwersytet Wrocławski

Dr hab. Monika Kaczmarek-Śliwińska I Uniwersytet Warszawski

Dr hab. Anna Kalinowska-Żeleźnik, prof. WSB Merito | Uniwersytet WSB Merito

Dr hab. Andrzej Lisak | WZiE Politechnika Gdańska

Dr hab. Krzysztof Leja, prof. PG | WZiE Politechnika Gdańska

Dr hab. Rafał Maciąg, prof. UJ | Uniwersytet Jagielloński

Dr hab. Weronika Świerczyńska-Głownia, prof. UJ I Uniwersytet Jagielloński

Dr Sylwia Kuczamer - Kłopotowska, Wydział Zarządzania, Uniwersytet Gdański | Pomorski Instytut Naukowy im. Profesora Brunona Synaka

KOMITET ORGANIZACYJNY

Dr Sylwia Kuczamer - Kłopotowska I Wydział Zarządzania, Uniwersytet Gdański | Pomorski Instytut Naukowy im. Profesora Brunona Synaka

Dr Marta Szeluga-Romańska | Wydział Zarządzania i Ekonomii, Politechnika Gdańska

Mgr Monika Hapek I Wydział Zarządzania i Komunikacji Społecznej, Uniwersytet Jagielloński

Mgr Anna Młynkowiak-Stawarz I Wydział Zarządzania, Uniwersytet Gdański | Pomorski Instytut Naukowy im. Profesora Brunona Synaka

Mgr Zuzanna Minga I Wydział Zarządzania, Uniwersytet Gdański

Olga Gałęska I Wydział Zarządzania, Uniwersytet Gdański

Mgr Barbara Cyrek I Wydział Zarządzania i Komunikacji Społecznej, Uniwersytet Jagielloński

Aleksandra Boike | Pomorski Instytut Naukowy im. Profesora Brunona Synaka

Sztuczna inteligencja a teoria nauki

Sztuczna inteligencja a zarządzanie humanistyczne

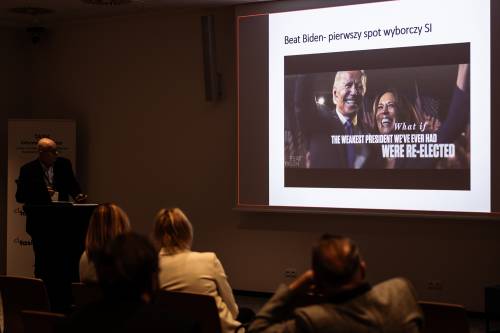

Sztuczna inteligencja a wybory/postawy polityczne, społeczne i decyzje gospodarcze

Wykorzystanie sztucznej inteligencji w zarządzaniu informacją i dezinformacją

Rola wykorzystania sztucznej inteligencji w uzależnieniu użytkowników, w tym wykorzystania tzw. manipulacyjnych wzorców (ang. dark pattern)

Wykorzystanie sztucznej inteligencji w zarządzaniu informacją, w tym w ramach doświadczenia użytkownika (CX i UX)

Rola nowych technologii w tworzeniu i doborze informacji (m.in. data journalism)

Ideologia, rola i tożsamości dziennikarzy i marketerów w obliczu sztucznej inteligencji

Wpływ sztucznej inteligencji na pracę (nie tylko w mediach i marketingu)

Chatboty a „koniec dziennikarstwa”

Chatboty a problemy prawne (prawo autorskie, problem odpowiedzialności za treści i dystrybucję)

Prelegenci

Jan Kreft

Anna Leszczuk-Fiedziukiewicz

Ewa Frąckiewicz

Monika Wawer

Anna Teler

Seweryn Puchała

Filip Świtkowski

Katarzyna Gajlewicz-Korab

Agnieszka Walecka-Rynduch

Paweł Horodecki

Barbara Cyrek

Anna Granat

Jacek Wojsław

Małgorzata Orłowska

Sławomir Soczyński

Paweł Kaszuba

Greta Gober

Piotr Maśloch

Anna Miotk

Aleksandra Chmielewska

Monika Przybysz

Katarzyna Drąg

Mariola Łuczak

Piotr Siuda

Stanisław Jędrzejewski

Radosław Sajna-Kunowsky

Magdalena Ratajczak

Edyta Gołąb-Andrzejak

Anna Lusińska

Michał Tomczak

Zbigniew Widera

Damian Guzek

Małgorzata Bulaszewska

Anna Jupowicz- Ginalska

Krzysztof Wasilewski

Beata Czechowska-Derkacz

Ewa Miłoszewska-Podrażka

Michał Głowacki

Weronika Świerczyńska-Głownia

Monika Boguszewicz-Kreft

Marta Szeluga-Romańska

Maria Nowina-Konopka

Małgorzata Majewska

Dariusz Dąbrowski

Jan Hudzik

Sławomir Magala

Robert Bęben

Lucyna Szot

Jan Stasieńko

Monika Kaczmarek-Śliwińska

Jan Pleszczyński

Agnieszka Grzechynka

Piotr Celiński

Rafał Maciąg

Anna Kalinowska-Żeleźnik

Sylwia Kuczamer-Kłopotowska

Iwona Hofman

Marek Kochan

Pakiety

Kontakt do organizatora

Pomorski Instytut Naukowy im. Prof. B. SynakaAdres wydarzenia

-

Politechnika Gdańska Centrum Kompetencji STOS

Politechnika Gdańska Centrum Kompetencji STOS

-

Narutowicza 11/12

Narutowicza 11/12